Kunst ohne Körper?

Was sich hinter der Fassade abspielt, offenbart sich erst bei genauerem Hinsehen. In der Medienbranche sind es jedenfalls die unzähligen Kreativschaffenden, die als Autor*innen, Editor*innen, Komponist*innen und Verleger*innen das Bewegtbild gestalten. Jede Filmsequenz soll fein abgestimmt sein, darf zum Nachdenken anregen und gezielt Emotionen hervorrufen. Denn Kunst findet im 21. Jahrhundert nicht mehr nur auf der Bühne statt, sondern kann dank der Digitalisierung von nahezu überall aus und zu jeder Uhrzeit genossen werden. Es liegt wohl in der Ironie des Schicksals, dass es die Künstler*innen als Rückgrat der Medienbranche sind, die der voranschreitenden Technologisierung mit als Erste zum Opfer fallen.

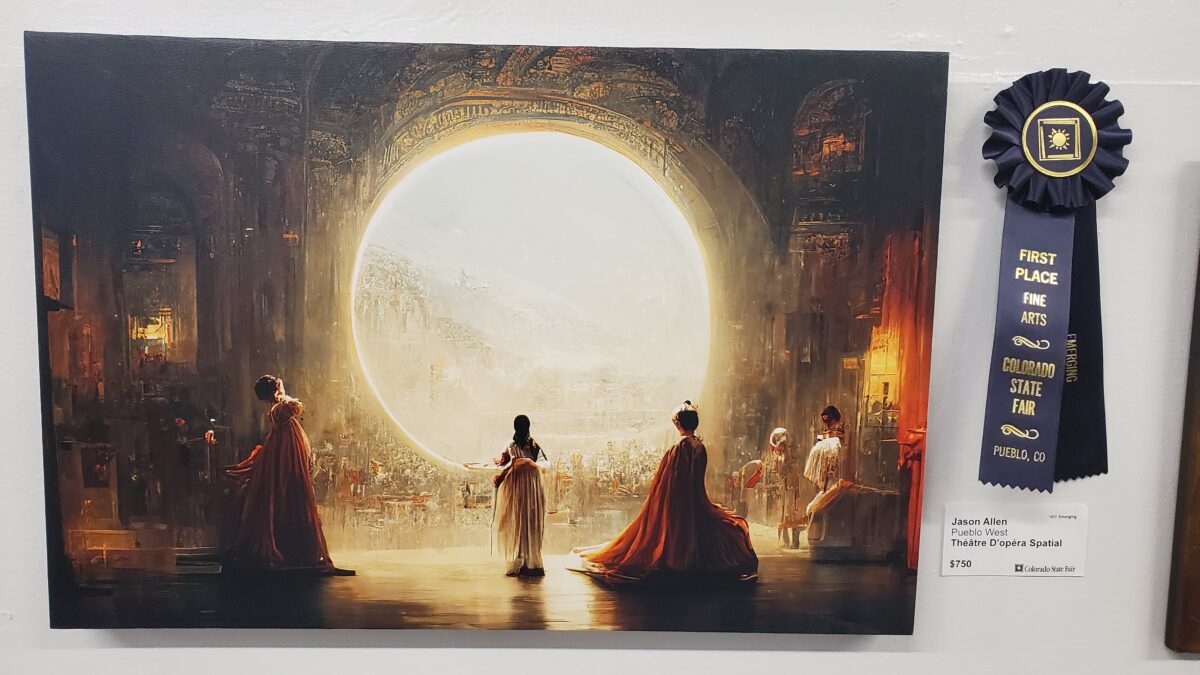

So scheint es zumindest, betrachtet man Programme wie DALL-E, die scheinbar wie aus Zauberhand simple Eingaben über ein Textfeld zu visuellen Meisterwerken verwandeln. Für Schlagzeigen sorgte erst kürzlich ein Fall, bei dem ein Partizipant der „Colorado State Fair’s fine arts competition 2022“ ein von künstlicher Intelligenz generiertes Bild einreichte…und gewann!

Selbsterklärend sind daher die Grundsatzdebatten über den Umgang mit künstlicher Intelligenz. Diese reichen vom Urheberrecht und Plagiarismus über künstlerische und materielle Wertigkeit bis hin zu der moralischen Verpflichtung den unzähligen Künstler*innen gegenüber, die dadurch ihre wirtschaftliche Zukunft bedroht sehen.

Auch wenn von knapp 100 befragten Komponisten und Verlegern im medialen Sektor nur jeder zehnte in AI-Kompositionstools wie „AIVA“ zum jetzigen Zeitpunkt eine konkrete Bedrohung sieht, merkt Gründer des Exklusivlabels „RipCueMusic“ Patrick Niesler in einem Gespräch mit terzwerk an:

„Allen ist klar, dass künstliche Intelligenz irgendwann alles kann, was auch der Mensch kann“. Gleichzeitig habe künstliche Intelligenz bereits in anderen Aufgabenbereichen, wie der Klassifizierung von Stücken in verschiedene Kategorien, Einzug gefunden. „Das kann durchaus nützlich sein, übernimmt man einen Katalog von über 10.000 Stücken und möchte diesen neue Schlagwörter zuordnen“.

Komponist und „Trailer-Titan“ Mark Petrie (DUNE, VENOM, AVENGERS: Infinity War, Endgame) zeigt sich bezüglich künstlicher Intelligenz ebenfalls zuversichtlich, deutet aber auch auf die Möglichkeit der Kooperation zwischen Mensch und „Maschine“ als Übergangsphase hin: „Ich gehe davon aus, dass KI für mindestens noch ein paar Jahrzehnte nicht in der Lage sein wird, ohne menschliche Hilfe etwas zu schaffen, das dem Produktionsstandard der Industrie entspricht.“ (aus dem Englischen frei übersetzt). Petrie geht es dabei um die Differenzierung von Komposition und Produktion; kurzgesagt den Unterschied zwischen dem, was an Notentext geschrieben ist und der künstlerischen Ausgestaltung dessen. Genau dieser Produktionsschritt bereitet künstlicher Intelligenz noch große Schwierigkeiten.

Am besten lässt sich dieser Unterschied wohl am Projekt „Beethoven X“ veranschaulichen, bei dem Beethovens unvollendete, zehnte Sinfonie von einem Forschungsteam um Dr. Matthias Röder mithilfe von künstlicher Intelligenz fertig gestellt wurde. Röder selbst berichtet queer.de gegenüber, dass die Ausgabe des Computers zunächst „trocken und emotionslos“ klang. An diesem Punkt sei es an dem Forschungsteam gewesen, aus Vorschlägen der KI gezielt auszuwählen. Nicht zuletzt waren es am Ende jedoch die Musiker des Beethoven Orchesters unter Dirk Kaftan, die am 9. Oktober 2021 dem vom Algorithmus generierten Konstrukt Leben einhauchten.

Umso erschreckender ist zu beobachten, was schon heute und für jeden zugänglich möglich ist.

Die von KI generierten Noten können als sogenannte „MIDI“-Befehle über virtuelle Instrumente direkt von einem Computer aus wiedergegeben werden. Komponisten greifen schon lange auf diese virtuellen Instrumente zurück, um auf ein teures Orchester verzichten und Änderungen unkompliziert vornehmen zu können. Ähnlich ist das auch bei dem nachfolgenden Beispiel… nur saß an der Stelle des Komponisten kein Mensch, sondern der Algorithmus namens „AIVA“.

Während die geübten Hörer*innen noch die teils holprige MIDI-Wiedergabe und den nicht optimalen Mix heraushören können, könnte es in Zukunft ganz anders aussehen. Virtuelle Instrumente werden realistischer, automatisierte MIDI-Programmierung wie „NotePerformer“ stets authentischer und das Mixing sowie Mastering zunehmend durch künstliche Intelligenz ergänzt. Das dürfte keine Überraschung sein, denn es forschen nicht nur fast jede deutsche Universität, sondern auch die größten Konzerne wie Google und Meta intensiv an verschiedensten Formen künstlicher Intelligenz. Noch kann niemand genau sagen, wohin die Reise geht. Fest steht nur, dass es eine Entwicklung ist, die in Zukunft großen Einfluss haben wird.

Entscheidend werden daher die nächsten Monate und Jahre sein, die in einer ohnehin angespannten Zeit die Grundlage für den Umgang mit künstlicher Intelligenz gestalten. Es ist nicht die Frage nach dem „Wer?“ oder „Wann?“, sondern nach dem „Wie?“. Betrachtet man die Schieflage im Streamingmarkt, dem sich zuspitzenden Ausverkauf der Musik durch Abo-Modelle und dem Schreckgespenst namens „künstliche Intelligenz“, verliert man schnell Verleger wie Niesler aus den Augen, für den es am Ende „um die menschliche Interaktion“ und „Wertschätzung menschlicher Genialität“ geht.